Lokale Smart Home LLM-Vision in Home Assistant: So versteht deine Kamera endlich, was sie sieht – ohne Cloud

Deine Überwachungskamera ist „smart“… aber eigentlich sagt sie dir nur zwei Dinge: Bewegung oder Person. Super. Und dann? Du willst doch nicht jedes Mal raten, ob da gerade der Postbote ein Paket hingelegt hat, ob der Hund im Garten rumturnt oder ob die Mülltonnen noch auf deinem Grundstück stehen.

Genau hier kommt LLM Vision ins Spiel – und zwar so, dass deine Kamera nicht nur „etwas“ erkennt, sondern in Klartext beschreibt, was wirklich passiert. Und ja: Man kann das alles mit OpenAI/Gemini in der Cloud machen. Aber ganz ehrlich… wenn dabei ständig Bilder von deinem Grundstück (oder deiner Familie) irgendwo auf US-Servern landen, ist das für viele ein Dealbreaker.

Ich zeige dir in diesem Artikel: LLM Vision + Home Assistant + Frigate – und das Ganze 100% lokal. Also: Kein Bild verlässt dein Netzwerk. Dazu bekommst du drei praxistaugliche Use Cases (Pakete, Mülltonne, Zusammenfassung) und ein Setup, das nicht dauerhaft deinen Server grillt.

Was ist LLM Vision überhaupt – und warum ist das der Gamechanger?

Eine normale Kamera-/NVR-Erkennung arbeitet oft nach dem Prinzip: Pixel → Objektklasse (Person, Auto, Hund). Das ist praktisch, aber begrenzt.

LLM Vision geht einen Schritt weiter: Es nimmt ein Bild (meist ein Snapshot), macht daraus eine textbasierte Beschreibung und gibt am Ende Text zurück – oft sogar strukturiert (z.B. JSON). Und Text ist genau das, womit Home Assistant so richtig gut arbeiten kann: Automationen, Benachrichtigungen, Zustände, Sensoren.

Kurz gesagt:

- Deine Kamera liefert ein Bild.

- Ein Vision-Modell „übersetzt“ das Bild in Merkmale.

- Ein LLM macht daraus Sprache: „Ein Paket liegt vor der Tür“ statt „Person erkannt“.

- Home Assistant nutzt das Ergebnis für Automationen.

Das fühlt sich an wie ein Gehirn für deine Augen: Pixel werden zu Bedeutung.

Frigate + LLM Vision: Bello (Wachhund) und Larry (Detektiv)

Damit das Ganze nicht ausufert (Performance, Energie, Kosten), kombiniere ich zwei Rollen:

- Frigate = Bello, der Wachhund

Bello ist schnell und effizient: Er erkennt Motion/Person/Auto und liefert dir Trigger-Events. - LLM Vision = Larry, der Detektiv

Larry ist schlauer, aber teurer: Er analysiert Bilder detailliert und beschreibt sie. Larry soll nicht 24/7 arbeiten, sondern nur wenn Bello anschlägt. Larry nutzt ein multimodales Vision-LLM: Er bekommt von deiner Kamera einen Snapshot, der für den Computer erstmal nur aus Pixeln besteht. Daraus extrahiert er Muster wie Kanten, Formen und typische Merkmale, baut sich daraus intern eine Art „Skizze“ der Szene (z.B. Tür, Boden, Paket, Person) und übersetzt das anschließend in Text-Tokens. Am Ende spuckt Larry eine verständliche Beschreibung oder sogar strukturierte Daten (z.B. JSON) aus – und genau damit kann Home Assistant dann Automationen auslösen oder Helfer/Sensoren setzen.

Genau diese Kombination ist in der Praxis Gold wert:

- Weniger Last auf deiner Hardware

- Weniger Analysen = weniger Wartezeit

- Und wenn du doch Cloud nutzt: weniger Token-Verbrauch

Datenschutz & Recht in Deutschland

Bevor wir technisch werden: Ein paar wichtige Punkte, die du Ernst nehmen solltest um Ärger zu vermeiden:

- Nur dein eigenes Grundstück filmen. Keine öffentliche Straße, keine Nachbarn, keine Gemeinschaftsflächen (Flur/Hof).

- Kein Audio aufnehmen bzw. deaktivieren (Larry muss „taub“ sein). Dauerhafte Audioaufnahmen im öffentlichen Kontext sind extrem heikel.

- Hinweisschild aufstellen: Menschen müssen wissen, dass sie gefilmt werden

Schritt 1: LLM Vision in Home Assistant installieren (HACS)

Um eine Kamera auszuwählen und mit Frigate in Home Assistant zu bringen schaue dir meinen Blogartikel dazu an. Zuletzt habe ich die Reolink TrackMix POE bei mir installiert:

Hinweis: Bei den oben angezeigten Links handelt es sich um Affiliate-Links. Als Amazon-Partner verdiene ich an qualifizierten Verkäufen. Es entstehen für Dich keine zusätzlichen Kosten.

Wenn du das schon erledigst hast geht es weiter:

Für das Setup brauchst du HACS (Home Assistant Community Store).

- Öffne HACS ( wie HACS installiert wird habe ich schon in anderen Youtube Videos erklärt)

- Suche nach “LLM Vision”

- Installieren

- Home Assistant neu starten

- Danach: Einstellungen → Geräte & Dienste → Integration hinzufügen → LLM Vision – Mit Standardeinstellungen auf OK

Ab hier hast du LLM Vision als Integration im System.

Schritt 2: Erster Test (zum Verständnis) – Bild analysieren

Hier wird als Referenz einmal OpenAI genutzt, um zu zeigen: „So sieht es aus, wenn es funktioniert.“

Du kannst das genauso machen – rein zum Testen:

- Einstellungen → LLM Vision → Eintrag hinzufügen

- Provider wählen (in diesem Fall: OpenAI) und API-Key setzen ( deinen API key findest du auf der OpenAI Seite bzw. kannst dort einen neuen API-Key erstellen)

- Dann testen über: Entwicklerwerkzeuge → Aktionen → Image Analyzer

- Aktion ausführen: Bei Integration „OpenAI“ auswählen

- Prompt eingeben: „Bitte analysiere und beschreibe das Bild auf Deutsch.“

- und noch die Kamera auswählen bei „Image Entity“ und los gehts

Dann sollte schon das Bild der ausgewählten Kamera beschrieben werden.

Das Bild der Testkamera wurde doch recht treffend beschrieben:

Wichtig: Das ist der Funktionscheck. Mein Ziel ist danach: Cloud rauswerfen und alles lokal machen!

Schritt 3: 100% lokal – Ollama + Gemma als Vision-Modell

Jetzt kommt der Teil, wegen dem ich das Ganze überhaupt gemacht habe: kein Bild verlässt mein Netzwerk.

Was du brauchst

- Eine Maschine, die das Modell lokal rechnen kann (in meinem Fall ein Mac mit Apple M2 Max, 64 GB RAM)

- Ollama

- Ein Vision-fähiges Modell (ich verwende: Gemma)

Installiere Ollama auf der Maschine und lade das Modell "Gemma" im Terminal herunter. Wie das genau funktioniert - dazu gibt es viele Tutorials.

Ollama als Provider in LLM Vision eintragen

- Einstellungen → LLM Vision → Neuer Eintrag

- Provider: Ollama

- IP-Adresse der Maschine eintragen, auf der Ollama läuft

- Modellname auswählen (z.B. Gemma3)

Danach: Wieder in Entwicklerwerkzeuge → Aktionen gehen und den gleichen Test machen – diesmal mit dem Ollama/Gemma-Provider.

Wenn das Ergebnis kommt: Glückwunsch. Dann läuft deine Bildanalyse lokal.

Antwort mit Ollama/Gemma:

Hat also auch lokal wunderbar funktioniert! Sehr gut.

Use Case 1: Paketerkennung vor der Tür (mit Schalter + Push-Nachricht)

Das ist mein Lieblingsbeispiel, weil es sofort echten Alltag löst: Pakete liegen rum, werden nass, bleiben ewig liegen – du willst einfach nur eine Nachricht: „Paket liegt da“.

Idee

- Frigate erkennt Person/Motion (Bello bellt)

- LLM Vision prüft: Liegt ein Paket vor der Tür?

- Ergebnis setzt einen Helper-Schalter (True/False)

- Zweite Automation schickt Push Nachricht aufs Handy, wenn der Schalter auf „An“ geht

1) Prompt (Data Analyzer) und Helper anlegen

Dafür wird in LLM Vision der Data Analyzer (Beta) genutzt, weil er direkt einen Sensor/Helper aktualisieren kann.

Prompt-Beispiel:

„Liegt ein oder mehrere Pakete vor der Tür?

Wieder in Entwicklerwerkzeuge → Aktionen → Sensor Entity → einen neuen Schalter-Helfer erstellen →

Name: „Paket liegt vor der Tür“ – Erstellen

Bei „Image Entity“ wieder die gewünschte Kamera auswählen

Dann noch im Dashboard hinzufügen: Editieren – Kachel – Paket ist vor der Tür (Boolesche Eingabe) – Speichern

3) Automation 1 bauen: Wenn Frigate triggert → Paket prüfen

Diese Automation ist der „Motor“: Sobald Frigate meldet „Person erkannt“ oder „Motion“, wird Larry aktiv und prüft das Bild.

- Gehe in Einstellungen → Automationen

- Neue Automation erstellen

- Auslöser (Trigger) hinzufügen:

- Entität→ Zustand

- Entität: Frigate-Entität (im Video z.B. Person Occupancy deiner Tür-/Gartenkamera)

- Von: beliebiger Zustand

- Zu: Belegt

- Beispiel: „Person Occupancy“ geht auf „on“

3. „Dann“

Aktion hinzufügen:

- Dienst/Aktion: LLM Vision → Data Analyzer (Beta)

- Integration/Provider: Gemma 3.12b (lokal)

- Prompt: „Liegt ein oder mehrere Pakete vor der Tür?“

- Sensor Entity : „Paket liegt vor der Tür“

- Image Entity: deine Kamera

- Speichern

- Name: z.B. „AI Paketerkennung Tür“

4) Automation 2 bauen: Wenn Helper auf „An“ → Push aufs Handy

- Einstellungen → Automationen

- Neue Automation erstellen

- Sobald: Auslöser (Trigger):

- Entität: „Paket liegt vor der Tür“

- Zustand

- Von: „Aus„

- Zu: „Ein“

- „Dann“: Aktion: Benachrichtigung – send a notification via mobile app ( Dein Handy muss hinterlegt sein)

- message: „Paket vor der Tür“ – speichern, Name: z.B. „AI Paketbenachrichtigung“

Stabilitäts-Tipp

Du kannst zusätzlich alle X Minuten prüfen lassen, ob das Paket noch da ist – damit der Helper wieder zurückgesetzt wird, wenn es weg ist. Das ist oft stabiler als „nur bei Person-Trigger“.

Use Case 2: „Steht die Mülltonne noch im Garten?“

Der zweite Case ist genauso simpel – und genauso praktisch.

- Neuer Helper-Schalter: „Mülleimer im Garten“

- Prompt:

- „Ist auf dem Bild ein Mülleimer zu sehen? Antworte nur true oder false.“

Auslöser-Idee

Setze bei der Automation im Zeitpunkt beispielsweise auf

Zeitbasiert: z.B. Donnerstag 18:00 Uhr → Prüfen → Notify, falls noch im Garten.

Und dazu wieder eine Push-Automation, wenn der Schalter auf „on“ geht. Dann ist es höchste Zeit die Mülleimer zur Abholung am Freitag noch nach draußen zu stellen.

Use Case 3: Zusammenfassung, was im Kamerabild passiert

Jetzt wird’s richtig cool: Nicht nur „Person erkannt“, sondern eine kurze Zusammenfassung, was im Ereignis passiert ist.

Dafür genutzt wird:

- LLM Vision Card (über HACS herunterladen (als Dashboard herunterladen))

- Blueprint (Timeline Card) herunterladen (Timeline-Card macht, das die die Events in deinem Dashboard gesammelt werden)

Blueprint importieren drücken: und diese URL einfügen:

https://raw.githubusercontent.com/valentinfrlch/ha-llmvision/refs/heads/main/blueprints/event_summary.yamlAI Event Summary auswählen

Blueprint Einstellungen

- Trigger z.B. Motion

- Cooldown z.B. 10 Minuten (damit Larry nicht dauernd ackert)

- Optional: „Wenn nix passiert, gib exakt ‘no activity observed’ zurück“

- Provider:Ollama- gemma3

- Notify Device: Dein Handy auswählen

Das Ergebnis ist eine Timeline wie ein kleines Protokoll:

„Eine Person läuft über den Rasen“, „Person auf der Treppe“, etc.

Das ist ideal, wenn du nicht dauernd Push-Nachrichten willst, aber später nachvollziehen möchtest, was los war.

Performance-Tuning: Damit deine Hardware nicht glüht

Das war eine der Kern-Challenges im Video: Lokal ja – aber bitte nicht mit Dauerlast.

Meine wichtigsten Hebel daraus:

- Larry nur triggern, wenn Bello bellt

Also: erst Frigate Motion/Person, dann LLM Vision. - Cooldown (z.B. 10 Minuten)

Gerade beim Event Summarizer extrem effektiv. - Snapshots statt Dauerstream

Du brauchst meist nur ein Bild (oder eine kurze Bildserie), nicht den ganzen Stream. - Prompt schlank halten

Frag exakt das, was du brauchst. Kein Roman. - Modellgröße bewusst wählen

12B kann besser sein als 4B – aber kostet mehr Ressourcen. Starte pragmatisch.

Fazit: Du bekommst Kameras, die wirklich „verstehen“ – und bleibst lokal

Wenn du das Setup einmal stehen hast, fühlt sich dein Smart Home plötzlich deutlich erwachsener an und mit Sicherheit kommen dir sehr viele Use Cases wie du LLM Vision überall noch einsetzen kannst :

- Pakete werden nicht mehr „übersehen“

- Mülltonnen-Reminder passiert automatisch

- Es wird Beschrieben was auf dem Video gesehen wird

- Und das Ganze ohne, dass dein Garten in irgendeiner Cloud landet

Wenn du das nachbauen willst und irgendwo hängst: Schreib mir gern, welchen Teil ich als nächstes noch detaillierter runterbrechen soll (Ollama-Setup, Modellwahl, Prompts, Automations-Feinschliff). Und wenn du sowieso gerade dabei bist, dein Smart Home wirklich lokal und sauber aufzubauen: Schau dir auch meine anderen Home-Assistant/ESPHome-Themen an – ich zeige dir Schritt für Schritt, wie du aus „Basteln“ ein System machst, das im Alltag zuverlässig läuft.

Du hast dieses Projekt erfolgreich umgesetzt? Mega – dann bist du schon weiter als 90 % der Leute, die sich „Smart Home“ auf die Fahne schreiben 😉

Wenn du jetzt merkst:

„Ich will das nicht nur nachbauen, ich will’s wirklich checken und eigene Projekte umsetzten “

dann lade ich dich in meinen

ESPHome Meisterkurs – Meisterwerkstatt für lokale Hardware ein.

Dort bekommst du:

- eine klare Roadmap von den Grundlagen bis zu eigenen Projekten

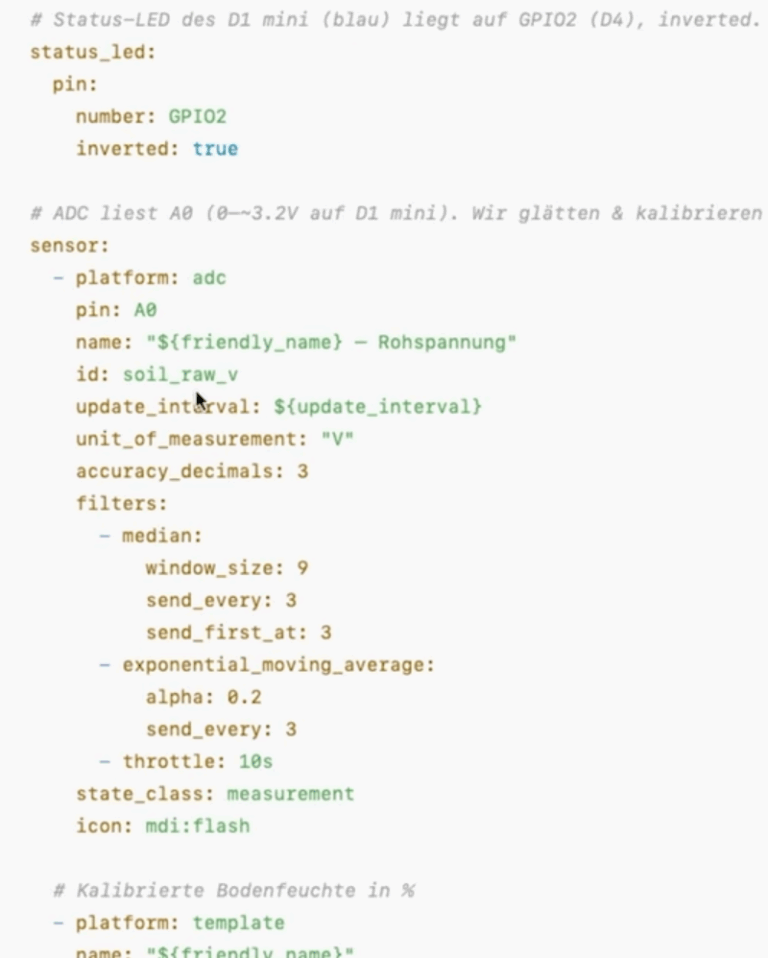

- fertige YAML-Vorlagen, die wir im Kurs Stück für Stück auseinandernehmen

- Praxisbeispiele aus der Community: Präsenzmelder, Garten, Lüftung, PV & Co.

Alex Kly (Alkly)

Ich glaube an ein Smart Home, das dir gehört – nicht der Cloud. Ich zeige dir, wie du Technik nutzt, um Energie zu sparen, Solar optimal einzubinden und dein Zuhause nachhaltig zu steuern.

Ein Zuhause, das mitdenkt, dich entlastet – und dich jeden Tag ein Stück freier macht.